Casi Studio & Strategie

Come l’intelligenza artificiale sta influenzando gli attacchi informatici

Nel 2025 le organizzazioni a livello globale hanno subito in media quasi 2.000 attacchi informatici a settimana — un incremento del 70% rispetto a soli due anni prima. In Italia il quadro è ancora più allarmante: il 9,6% degli incidenti mondiali ha colpito il nostro Paese, con una crescita del 42% rispetto al 2024 e un aumento del 290% nel settore governativo-militare. La causa principale di questa accelerazione? L’intelligenza artificiale. Capire come l’intelligenza artificiale sta influenzando gli attacchi informatici non è più una questione accademica riservata ai CISO delle grandi aziende — è una priorità per chiunque operi nel mondo digitale.

Questo articolo analizza in profondità il modo in cui l’AI sta ridefinendo sia l’offesa sia la difesa nel cyberspazio: dalle campagne di phishing iper-personalizzate ai deepfake che ingannano i vertici aziendali, dai malware che si adattano in tempo reale alle difese che incontrano fino ai sistemi di rilevamento anomalie che usano la stessa tecnologia per proteggere le infrastrutture. Alla fine avrai un quadro chiaro, aggiornato e pratico di cosa sta cambiando e come prepararti.

- Lo scenario 2026: i numeri dell’emergenza

- La doppia faccia dell’AI nella cybersecurity

- Phishing potenziato dall’AI: la minaccia più diffusa

- Deepfake e voice cloning: l’inganno perfetto

- Malware adattivo e ransomware AI-powered

- Social engineering multicanale

- Attacchi ai sistemi di AI: prompt injection e data poisoning

- Come l’AI difende: detection, SOAR e agenti autonomi

- Il caso Italia: rapporto Clusit 2026

- Timeline: l’evoluzione degli attacchi AI dal 2022 al 2026

- Come proteggersi: 10 azioni concrete per aziende e individui

- NIS2 e regolamentazione: cosa impone la legge

- FAQ — Domande frequenti

- Conclusione

Lo scenario 2026: i numeri dell’emergenza

Per comprendere come l’intelligenza artificiale sta influenzando gli attacchi informatici è necessario partire dai dati. Il Cyber Security Report 2026, basato su dati di telemetria che coprono circa il 20% del traffico internet globale, traccia un quadro inequivocabile: l’AI non è più un fattore marginale nel panorama delle minacce — ne è il motore principale di accelerazione.

L’incremento non riguarda solo il volume degli attacchi, ma la loro qualità e sofisticazione. L’intelligenza artificiale ha permesso ai criminali informatici di automatizzare operazioni che prima richiedevano settimane di lavoro manuale: dalla ricognizione iniziale del bersaglio alla personalizzazione dell’attacco, dalla creazione di contenuti fraudolenti credibili alla negoziazione dei riscatti ransomware.

In Italia sono stati rilevati 507 incidenti informatici significativi nel 2025, rispetto ai 357 del 2024 — un aumento del 42%. Il settore governativo-militare è stato il più colpito, con il 28% degli attacchi totali e un incremento del 290% in valore assoluto. L’analisi su oltre sette milioni di indirizzi IP italiani ha registrato 87 milioni di eventi di sicurezza, con il numero di dispositivi compromessi più che raddoppiato rispetto all’anno precedente.

Ciò che rende questo momento storico particolarmente critico è il concetto espresso dalla presidente del Clusit, Anna Vaccarelli: l’intelligenza artificiale rappresenta un “moltiplicatore di rischio”. Non si tratta semplicemente di attacchi più frequenti, ma di attacchi che si evolvono più velocemente della capacità umana di rispondere ad essi.

La doppia faccia dell’AI nella cybersecurity

L’intelligenza artificiale è un’arma a doppio taglio nella sicurezza informatica. Da un lato, i criminali informatici la usano per rendere gli attacchi più rapidi, personalizzati e difficili da rilevare. Dall’altro, i team di sicurezza la impiegano per rilevare anomalie, automatizzare la risposta agli incidenti e analizzare volumi di dati impossibili da gestire manualmente.

Questa dualità genera una dinamica di corsa agli armamenti digitale: ogni progresso nella capacità difensiva dell’AI viene controbilanciato da un’innovazione offensiva, e viceversa. Il risultato è un ecosistema in cui la velocità di adattamento è diventata il fattore competitivo più critico — più importante della potenza computazionale, più importante del budget.

LLM generano email perfette, personalizzate sul destinatario, nel suo stile, con riferimenti contestuali accurati. Eliminati errori grammaticali e genericità.

Voice cloning per simulare dirigenti aziendali in chiamate e videochiamate. Perdite documentate nell’ordine di milioni di euro.

Codice malevolo che modifica il proprio comportamento in tempo reale in base alle difese che incontra, evadendo autonomamente i sistemi di protezione.

AI usata per selezionare bersagli, negoziare riscatti e ottimizzare l’efficienza operativa. +53% di vittime di estorsione nel 2025.

AI che identifica pattern di traffico insoliti, accessi da posizioni anomale e comportamenti utente che deviano dalla baseline.

Isolamento automatico di endpoint compromessi, blocco di IP sospetti e disattivazione di account in secondi, non in ore.

Sistemi di nuova generazione che apprendono continuamente e migliorano le strategie difensive in tempo reale. Google e Wiz in prima linea.

Correlazione automatica degli eventi, prioritizzazione delle minacce e riduzione drastica dei falsi positivi nel Security Operations Center.

L’uso crescente e sempre più sofisticato dell’AI ha certamente consolidato l’automazione di tipologie di attacco che fino a qualche anno fa erano solo manuali. — Sofia Scozzari, Comitato Direttivo Clusit, Rapporto 2026

Phishing potenziato dall’AI: la minaccia più diffusa

Il phishing è da anni il vettore di attacco più utilizzato al mondo. Quello che l’intelligenza artificiale ha cambiato non è la tecnica in sé, ma la sua efficacia. Le campagne di phishing tradizionali avevano limiti evidenti: errori grammaticali, messaggi generici, contesti poco credibili. L’AI generativa ha eliminato sistematicamente ciascuno di questi limiti.

Come funziona il phishing AI-powered

I modelli linguistici di grandi dimensioni (LLM) consentono ai criminali informatici di generare email perfette dal punto di vista linguistico, personalizzate sul destinatario specifico, scritte nel suo stile comunicativo e con riferimenti contestuali accurati estratti da dati pubblicamente disponibili — profili LinkedIn, siti aziendali, comunicati stampa, post sui social media.

Il processo tipico di un attacco phishing potenziato dall’AI segue questa sequenza:

Ricognizione automatizzata

L’AI analizza automaticamente i profili social, le email pubbliche e i contenuti aziendali del bersaglio per costruire un profilo dettagliato: ruolo aziendale, colleghi, tono di comunicazione, progetti in corso, interessi personali.

Generazione del contenuto

Un LLM genera un’email che sembra provenire da un collega, un fornitore o un dirigente. Il tono, il formato e i riferimenti contestuali sono calibrati sul profilo del destinatario. Non ci sono errori grammaticali, non c’è genericità — l’email è indistinguibile da una comunicazione autentica.

Distribuzione scalabile

L’automazione AI permette di produrre migliaia di varianti uniche della stessa email, ciascuna personalizzata per un destinatario diverso. Non si tratta più di una singola email inviata a migliaia di persone, ma di migliaia di email uniche inviate a persone specifiche — rendendo i filtri anti-spam tradizionali molto meno efficaci.

Adattamento in tempo reale

Se il destinatario interagisce — anche parzialmente — con l’email, l’AI può adattare i messaggi successivi in base alla risposta ricevuta, creando una conversazione naturale che aumenta progressivamente la fiducia del bersaglio.

La personalizzazione estrema resa possibile dall’AI significa che il vecchio consiglio “controlla gli errori grammaticali” non funziona più. Le email di phishing AI sono grammaticalmente perfette, contestualmente accurate e tonalmente coerenti. L’unica difesa efficace è la verifica indipendente: se un’email chiede un’azione insolita (un pagamento, la condivisione di credenziali, un download), verifica con il mittente attraverso un canale diverso — una telefonata, un messaggio diretto, un incontro di persona.

Deepfake e voice cloning: l’inganno perfetto

Se il phishing AI-powered colpisce attraverso il testo, i deepfake portano l’inganno su un piano ancora più insidioso: il suono e l’immagine. La tecnologia di voice cloning (clonazione vocale) e di video deepfake è maturata rapidamente e, nel 2025-2026, ha iniziato a essere usata in modo sistematico nel contesto aziendale.

Casi documentati nel contesto aziendale

Diversi casi documentati nel 2025 hanno coinvolto aziende europee con perdite nell’ordine di milioni di euro. Lo schema è ricorrente: un dirigente aziendale riceve una telefonata — o addirittura una videochiamata — in cui il CEO o il CFO dell’azienda chiede con urgenza un bonifico, un trasferimento di dati o l’approvazione di una transazione straordinaria. La voce e l’immagine sono generate dall’AI, ma sono talmente realistiche da ingannare anche colleghi esperti.

La combinazione di voice cloning e AI generativa rende queste frodi estremamente credibili e difficili da verificare in tempo reale. Bastano pochi minuti di registrazione audio della voce del bersaglio — facilmente reperibili da interviste, podcast, conferenze o webinar pubblicati online — per creare un clone vocale convincente.

L’evoluzione della minaccia

Nel 2024, i deepfake erano ancora riconoscibili con attenzione — artefatti nei movimenti labiali, incoerenze nell’illuminazione, qualità audio imperfetta. Nel 2026, la tecnologia ha raggiunto un livello di realismo che rende il riconoscimento visivo quasi impossibile in tempo reale, specialmente in contesti di bassa qualità video come le videochiamate aziendali.

La contromisura più efficace non è tecnologica, ma procedurale: implementare processi di doppia verifica per qualsiasi richiesta finanziaria o operativa ricevuta tramite canali digitali. Se il CEO chiama per chiedere un bonifico urgente, la procedura deve prevedere una conferma attraverso un secondo canale indipendente — una chiamata di ritorno su un numero verificato, un’approvazione scritta, una conferma in persona. Nessuna tecnologia AI può aggirare un processo ben progettato.

Malware adattivo e ransomware AI-powered

L’AI non si limita a migliorare le tecniche di ingegneria sociale — sta trasformando anche il codice malevolo stesso. I malware AI-powered rappresentano una categoria emergente di minacce particolarmente insidiose perché capaci di evolversi autonomamente.

Malware che si adatta alle difese

Un malware tradizionale segue un set di istruzioni predeterminate: infetta il sistema, si diffonde, esfiltra dati o cripta i file. Un malware AI-powered fa qualcosa di radicalmente diverso: analizza l’ambiente in cui si trova — le difese attive, i sistemi di monitoraggio, i pattern di attività degli utenti — e modifica il proprio comportamento per evitare il rilevamento.

Se il malware rileva un sistema di monitoraggio del traffico di rete, può ridurre il volume di dati esfiltrati o cambiarla tempistica per mimetizzarsi nel traffico legittimo. Se incontra un sandbox di analisi, può simulare un comportamento benigno fino a quando non rileva un ambiente di produzione reale. Se il sistema antivirus riconosce una sua firma, può mutare il proprio codice per generare una variante non ancora catalogata.

Ransomware: selezione AI dei bersagli

L’ecosistema ransomware si è decentralizzato in gruppi più piccoli e specializzati nel 2025, con un aumento del 53% delle vittime di estorsione e del 50% dei nuovi gruppi ransomware-as-a-service (RaaS). L’intelligenza artificiale viene impiegata in ogni fase dell’operazione: dalla selezione dei bersagli più redditizi (analizzando fatturati, polizze assicurative cyber e capacità di pagamento), alla personalizzazione del messaggio di riscatto, fino alla negoziazione automatizzata del prezzo.

2. ACCESSO INIZIALE → Phishing personalizzato o exploit zero-day

3. MOVIMENTO LATERALE → Malware adattivo identifica i sistemi critici

4. ESFILTRAZIONE → Dati sensibili copiati prima della cifratura

5. CIFRATURA → File critici criptati con algoritmi avanzati

6. ESTORSIONE → Richiesta di riscatto calibrata sul profilo finanziario

7. NEGOZIAZIONE AI → Chatbot automatizzato gestisce il contatto con la vittima

Attacchi ai sistemi di AI: prompt injection e data poisoning

Un fronte meno visibile ma potenzialmente devastante riguarda gli attacchi diretti ai sistemi di intelligenza artificiale che le aziende stanno integrando nei propri processi. Man mano che le organizzazioni adottano chatbot AI interni, sistemi decisionali automatizzati e modelli di analisi predittiva, questi stessi sistemi diventano bersagli.

Prompt injection

La prompt injection è una tecnica che manipola le istruzioni di un sistema AI per fargli produrre output non previsti — risposte fuorvianti, divulgazione di dati riservati, esecuzione di azioni non autorizzate. Se un chatbot aziendale è integrato con i sistemi interni (database clienti, CRM, sistemi di ticketing), una prompt injection riuscita può trasformarlo in un vettore di esfiltrazione dati o in uno strumento per bypassare i controlli di accesso.

Data poisoning

Il data poisoning è un attacco più sottile e di lungo termine: consiste nell’inserire dati manipolati nei dataset di addestramento di un modello AI aziendale. Se un’azienda usa un modello di AI per classificare email, valutare rischi creditizi o filtrare candidature, l’inserimento di dati corrotti nel training set può compromettere sistematicamente le decisioni del modello — creando backdoor invisibili che si attivano solo in condizioni specifiche.

Man mano che le aziende integrano l’AI nei processi decisionali critici — dalla valutazione dei rischi finanziari alla selezione del personale, dall’approvazione dei pagamenti alla gestione della supply chain — i vettori di attacco data poisoning e prompt injection diventano sempre più rilevanti. Un modello compromesso può produrre decisioni sistematicamente errate senza che nessuno se ne accorga, perché la distorsione è sottile e distribuita nel tempo.

Come l’AI difende: detection, SOAR e agenti autonomi

Se l’intelligenza artificiale potenzia l’attacco, la stessa tecnologia rappresenta anche l’arma difensiva più potente disponibile. I sistemi di sicurezza tradizionali, basati su firme e regole statiche, sono sempre più inadeguati contro minacce sofisticate e in continua evoluzione. L’AI introduce capacità difensive radicalmente superiori.

Rilevamento anomalie basato su AI

A differenza dei sistemi tradizionali che cercano pattern noti (firme di malware, indirizzi IP noti come malevoli), l’AI difensiva apprende il comportamento “normale” di un sistema — pattern di traffico, orari di accesso, volumi di dati, sequenze di operazioni — e rileva qualsiasi deviazione significativa. Questo approccio è particolarmente efficace contro le minacce zero-day e gli attacchi che non corrispondono a firme note.

SOAR — Security Orchestration, Automation and Response

L’automazione della risposta permette di contenere un attacco in secondi. Un Security Operations Center moderno utilizza l’AI per il triage automatico degli alert, la correlazione degli eventi e la prioritizzazione delle minacce. Azioni che prima richiedevano intervento manuale — isolamento di un endpoint compromesso, blocco di un IP sospetto, disattivazione di un account — vengono eseguite in tempo reale sulla base di playbook predefiniti e arricchiti dall’AI.

Agenti AI autonomi: la nuova frontiera

Google sta investendo massicciamente in un modello di difesa basato su agenti AI capaci di operare alla velocità delle minacce moderne. Con l’acquisizione di Wiz per 32 miliardi di dollari, l’azienda sta costruendo un ecosistema in cui agenti AI non si limitano a reagire agli attacchi noti, ma apprendono continuamente, migliorano le proprie strategie difensive e intercettano le minacce prima che si trasformino in incidenti concreti. L’obiettivo è una difesa che non sia più solo reattiva, ma proattiva e auto-ottimizzante.

Il vantaggio fondamentale dell’AI in difesa è la velocità. Un attaccante umano assistito dall’AI può preparare un attacco sofisticato in poche ore. Un sistema difensivo AI può rilevare, analizzare e contenere lo stesso attacco in secondi. La velocità di risposta — non la sofisticazione della difesa — è il fattore che determina il danno reale di un incidente.

Il caso Italia: rapporto Clusit 2026

L’Italia è un caso di studio particolarmente significativo per comprendere come l’intelligenza artificiale sta influenzando gli attacchi informatici in un contesto di economia avanzata ma con un tessuto industriale fortemente basato su piccole e medie imprese.

Il Rapporto Clusit 2026 — prodotto dall’Associazione Italiana per la Sicurezza Informatica, che rappresenta oltre 700 organizzazioni di tutti i settori — offre dati allarmanti e specifici per il contesto italiano:

| Indicatore | 2024 | 2025 | Variazione |

|---|---|---|---|

| Incidenti significativi in Italia | 357 | 507 | +42% |

| Quota su incidenti globali | ~8% | 9,6% | In aumento |

| Settore gov-militare | — | 28% del totale | +290% |

| Settore manifatturiero | — | 12,6% del totale | In aumento |

| Attivismo cyber | — | 39% degli incidenti | +145% |

| Eventi di sicurezza su rete italiana | ~69 milioni | 87 milioni | +26% |

| Dispositivi compromessi (IP unici) | baseline | +100% | Raddoppiati |

Un dato particolarmente preoccupante riguarda il settore manifatturiero: il 16% degli attacchi al manifatturiero a livello mondiale ha riguardato aziende italiane — una quota sproporzionata rispetto al peso economico del Paese. Questo riflette la vulnerabilità di un tessuto industriale dove molte PMI non dispongono di risorse dedicate alla cybersecurity e si trovano esposte ad attacchi sempre più sofisticati e automatizzati dall’AI.

Timeline: l’evoluzione degli attacchi AI dal 2022 al 2026

Per contestualizzare l’accelerazione attuale, è utile ripercorrere come l’intelligenza artificiale si è inserita nel panorama degli attacchi informatici negli ultimi quattro anni.

Lancio di ChatGPT. I ricercatori di sicurezza identificano immediatamente il potenziale di abuso dei modelli linguistici per la generazione di email di phishing, la creazione di codice malevolo e l’ingegneria sociale automatizzata. Le prime proof-of-concept dimostrano che l’AI può generare email di phishing più efficaci dei template manuali.

Primi attacchi AI documentati in the wild. Emergono i primi casi di phishing potenziato da LLM su scala significativa. Si diffondono strumenti come WormGPT e FraudGPT, varianti di LLM senza restrizioni etiche vendute nel dark web. La voice cloning diventa accessibile con costi minimi.

Industrializzazione degli attacchi AI. Le campagne di phishing AI passano dall’essere esperimenti a operazioni industriali. Deepfake video usati in attacchi aziendali con perdite milionarie. Il ransomware integra AI nella selezione dei bersagli e nella negoziazione. I modelli open-source rendono l’AI offensiva accessibile a qualsiasi gruppo criminale.

Il punto di svolta. +70% di attacchi settimanali globali. L’89% delle organizzazioni rileva richieste AI rischiose. Social engineering multicanale coordinato dall’AI diventa la norma. Il ransomware-as-a-service integra chatbot AI per la negoziazione automatica. L’Italia registra 507 incidenti significativi.

AI agenti autonomi su entrambi i fronti. Gli attaccanti usano agenti AI che conducono l’intero ciclo dell’attacco — dalla ricognizione all’esfiltrazione — con minimo intervento umano. I difensori rispondono con agenti AI difensivi capaci di apprendere e adattarsi in tempo reale. Google investe 32 miliardi in Wiz. La Direttiva NIS2 diventa pienamente operativa in UE.

Come proteggersi: 10 azioni concrete per aziende e individui

Implementa l’autenticazione multifattore (MFA) ovunque

L’MFA è la singola contromisura più efficace contro il phishing AI. Anche se un dipendente fornisce le proprie credenziali in un attacco di phishing, l’MFA impedisce all’attaccante di accedere al sistema. Privilegia MFA basata su token fisici (FIDO2) o app di autenticazione — gli SMS sono vulnerabili al SIM swapping.

Crea processi di doppia verifica per le operazioni finanziarie

Qualsiasi richiesta di bonifico, trasferimento dati o modifica di coordinate bancarie ricevuta via email, telefono o chat deve essere verificata attraverso un secondo canale indipendente. Questa è la difesa più efficace contro deepfake e voice cloning.

Investi in formazione continua sulla cybersecurity

La consapevolezza degli utenti è ancora la prima linea di difesa. Ma i programmi di formazione devono aggiornarsi: non basta più insegnare a riconoscere email con errori grammaticali. Bisogna formare le persone a diffidare di richieste insolite anche quando sono perfettamente formulate.

Adotta soluzioni di sicurezza basate sull’AI

I sistemi di sicurezza tradizionali basati su firme non sono più sufficienti contro minacce AI-powered. Investi in soluzioni EDR/XDR che usano l’AI per il rilevamento di anomalie comportamentali e la risposta automatizzata agli incidenti.

Segmenta la rete e applica il principio del minimo privilegio

La segmentazione di rete limita il danno di un attacco riuscito. Se un segmento viene compromesso, il malware adattivo non può spostarsi lateralmente verso i sistemi critici. Il principio del minimo privilegio garantisce che ogni utente abbia accesso solo alle risorse necessarie per il proprio ruolo.

Esegui simulazioni di attacco regolari

Conduci test di phishing simulato — inclusi scenari AI-powered — per verificare la preparazione dei dipendenti. Conduci penetration test periodici che includano scenari con deepfake e social engineering multicanale. Le simulazioni devono evolversi al ritmo delle minacce.

Proteggi i tuoi sistemi AI interni

Se la tua azienda usa chatbot, modelli predittivi o sistemi decisionali AI, implementa controlli specifici: validazione degli input, monitoraggio degli output, test di robustezza contro prompt injection e data poisoning. Tratta i tuoi modelli AI come sistemi critici.

Implementa backup immutabili e un piano di incident response

Contro il ransomware, la difesa più efficace è avere backup recenti, testati e non raggiungibili dal malware (immutabili). Un piano di risposta agli incidenti aggiornato, con ruoli e responsabilità chiari, riduce drasticamente il tempo di contenimento e il danno complessivo.

Monitora la tua superficie di attacco esterna

Usa strumenti di External Attack Surface Management (EASM) per identificare asset esposti, credenziali compromesse e menzioni nel dark web. L’AI degli attaccanti parte dalla ricognizione: riduci la quantità di informazioni pubblicamente disponibili sulla tua organizzazione.

Prepara la conformità NIS2

La Direttiva NIS2, pienamente operativa dal 2026, impone alle aziende nel perimetro di adottare misure tecniche e organizzative per la gestione del rischio cyber, inclusa la capacità di rilevare e notificare gli incidenti significativi. Le sanzioni possono arrivare fino a 10 milioni di euro. Verifica se la tua organizzazione rientra nel perimetro e inizia l’adeguamento.

NIS2 e regolamentazione: cosa impone la legge

Il panorama normativo europeo si è evoluto rapidamente per rispondere all’accelerazione delle minacce AI-powered. Due regolamenti in particolare impattano direttamente le organizzazioni italiane nel 2026.

Direttiva NIS2 — Network and Information Security

La NIS2, pienamente operativa dal 2026, estende significativamente il perimetro delle organizzazioni obbligate a implementare misure di cybersecurity rispetto alla precedente NIS1. Non riguarda più solo le infrastrutture critiche tradizionali (energia, trasporti, sanità), ma include anche il settore manifatturiero, i servizi digitali, la gestione dei rifiuti, la produzione alimentare, i servizi postali e molti altri settori. Le aziende nel perimetro devono adottare misure tecniche e organizzative proporzionate al rischio, implementare capacità di detection e response, notificare gli incidenti significativi entro 24 ore e dimostrare la conformità attraverso audit periodici.

AI Act — Regolamento sull’Intelligenza Artificiale

L’AI Act europeo, il primo regolamento al mondo specificamente dedicato all’intelligenza artificiale, introduce obblighi per le organizzazioni che sviluppano o utilizzano sistemi AI in contesti ad alto rischio. Nel contesto della cybersecurity, questo significa che i sistemi AI usati per la sicurezza — ma anche quelli usati per la sorveglianza, la valutazione del rischio e le decisioni automatizzate — devono soddisfare requisiti di trasparenza, robustezza e supervisione umana.

L’intersezione tra NIS2 e AI Act crea un quadro normativo in cui le aziende devono simultaneamente proteggere i propri sistemi AI dagli attacchi e garantire che i propri sistemi AI difensivi operino in modo trasparente e conforme. È una complessità nuova, che richiede competenze giuridiche e tecniche integrate.

FAQ — Domande frequenti

L’AI sta accelerando e sofisticando ogni fase degli attacchi informatici: dalla ricognizione automatizzata dei bersagli alla creazione di phishing iper-personalizzato, dai deepfake per il social engineering al malware che si adatta autonomamente alle difese. Il risultato è un aumento del 70% degli attacchi settimanali globali rispetto al 2023, con minacce che evolvono più velocemente della capacità umana di risposta.

I più pericolosi sono il phishing AI-powered (email perfette e personalizzate), i deepfake vocali e video per frodi aziendali, il malware adattivo che evade autonomamente i sistemi di sicurezza, il ransomware con selezione intelligente dei bersagli e il social engineering multicanale coordinato.

Sì. L’AI difensiva è altrettanto potente: rileva anomalie comportamentali, automatizza la risposta agli incidenti (SOAR), esegue il triage degli alert in tempo reale e — nella sua forma più avanzata — opera come agente autonomo capace di apprendere e adattarsi continuamente alle minacce emergenti.

La difesa più efficace è una combinazione di tecnologia e processo: implementa l’autenticazione multifattore (MFA) su tutti i servizi, adotta soluzioni di email security basate sull’AI, forma i dipendenti a verificare le richieste insolite attraverso canali indipendenti e non fidarti di un’email solo perché è ben scritta.

Sì, e i casi documentati nel 2025 lo confermano. Aziende europee hanno subito perdite milionarie a causa di videochiamate deepfake in cui presunti dirigenti richiedevano bonifici urgenti. La contromisura più efficace è implementare processi di doppia verifica per le operazioni finanziarie.

La NIS2, pienamente operativa dal 2026, obbliga le aziende nel perimetro (ampliato rispetto alla NIS1) ad adottare misure di cybersecurity proporzionate, implementare capacità di detection e response, notificare gli incidenti significativi entro 24 ore e sottoporsi ad audit. Le sanzioni possono arrivare fino a 10 milioni di euro.

Sì, e in misura crescente. L’AI abbassa le barriere all’ingresso per i criminali informatici, rendendo economicamente vantaggioso attaccare anche bersagli più piccoli. Le PMI spesso non dispongono di risorse dedicate alla cybersecurity, il che le rende bersagli attraenti per il ransomware automatizzato.

Il data poisoning è l’inserimento di dati manipolati nei dataset di addestramento di un modello AI, compromettendo le sue decisioni future. Se la tua azienda usa AI per classificare email, valutare rischi o prendere decisioni automatizzate, un modello compromesso può produrre risultati sistematicamente errati senza che nessuno se ne accorga.

I costi variano enormemente in base alla dimensione dell’azienda e alla gravità dell’attacco. Oltre al riscatto (che può andare da decine di migliaia a milioni di euro), vanno considerati i costi di downtime, ripristino dei sistemi, perdita di dati, danni reputazionali, costi legali e potenziali sanzioni NIS2. Il Rapporto FBI 2025 stima i danni globali della criminalità informatica oltre 20 miliardi di dollari.

No. L’AI automatizza le operazioni ripetitive (triage, correlazione, risposta automatizzata), ma le decisioni strategiche, la comprensione del contesto aziendale, la progettazione delle architetture di sicurezza e la gestione delle crisi richiedono competenze umane. Il ruolo del professionista della cybersecurity non sparisce — si evolve verso la supervisione e l’ottimizzazione dei sistemi AI difensivi.

Conclusione

Comprendere come l’intelligenza artificiale sta influenzando gli attacchi informatici è il primo passo per difendersi efficacemente. Il 2026 segna un punto di svolta: le minacce basate sull’AI non sono più scenari teorici discussi nelle conferenze di sicurezza — sono realtà operative che colpiscono quotidianamente organizzazioni di ogni dimensione e settore, con un’intensità che cresce mese dopo mese.

La corsa agli armamenti digitale tra attaccanti e difensori è destinata ad accelerare. Ma c’è una differenza fondamentale: mentre l’attacco può essere completamente automatizzato, la difesa efficace richiede sempre una componente umana — la consapevolezza, il giudizio critico, la capacità di progettare processi che l’AI non può aggirare. È questa combinazione di tecnologia e intelligenza umana che farà la differenza.

Il futuro della cybersecurity non sarà determinato da chi ha la tecnologia più avanzata, ma da chi saprà utilizzarla con maggiore saggezza — bilanciando innovazione e sicurezza, velocità e prudenza, apertura e protezione. — ICT Security Magazine, sulla trasformazione del settore

Le dieci azioni concrete elencate in questa guida — dall’MFA alla formazione, dalla segmentazione di rete alla conformità NIS2 — non sono opzionali. Sono il minimo indispensabile per operare in un mondo dove l’intelligenza artificiale ha reso ogni attacco più veloce, più personalizzato e più difficile da rilevare. Il costo di non agire non è più un rischio teorico — è una certezza statistica.

Proteggi la tua organizzazione

L’AI sta accelerando le minacce informatiche. La consapevolezza è il primo passo per una difesa efficace.

-

Casi Studio & Strategie2 mesi ago

Casi Studio & Strategie2 mesi agoAffiliate Marketing 2026: Perché l’AI cambierà tutto

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCreare video con intelligenza artificiale gratis

-

Casi Studio & Strategie4 giorni ago

Casi Studio & Strategie4 giorni agoIA per Creare Immagini

-

Software & Tool AI6 giorni ago

Software & Tool AI6 giorni agoMusica con AI: Guida Completa ai Migliori Strumenti per Creare Canzoni con l’Intelligenza Artificiale nel 2026

-

Casi Studio & Strategie1 settimana ago

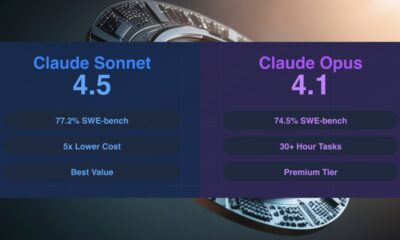

Casi Studio & Strategie1 settimana agoClaude Sonnet vs opus

-

Casi Studio & Strategie6 giorni ago

Casi Studio & Strategie6 giorni agoRicerca Generativa: Come l’AI Sta Rivoluzionando Google e Cosa Cambia per il Tuo Sito nel 2026

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCome attivare intelligenza artificiale su iphone

-

Software & Tool AI6 giorni ago

Software & Tool AI6 giorni agoSEO AI Free Tools: I Migliori Strumenti Gratuiti per Ottimizzare il Tuo Sito con l’Intelligenza Artificiale nel 2026

Social engineering multicanale

Un’evoluzione significativa documentata nel 2025-2026 è il passaggio da attacchi single-channel (tipicamente email) ad attacchi multicanale coordinati. L’AI permette ai criminali informatici di orchestrare campagne che coinvolgono simultaneamente email, telefonate, SMS, piattaforme di messaggistica e strumenti di collaborazione aziendale come Slack, Teams o Google Chat.

Uno scenario tipico potrebbe svolgersi così: il bersaglio riceve un’email apparentemente legittima da un fornitore che annuncia un cambio di coordinate bancarie. Pochi minuti dopo, riceve un messaggio su Teams da quello che sembra un collega del reparto contabilità che conferma il cambio. Se il bersaglio chiama il numero del fornitore indicato nell’email, risponde un sistema automatizzato AI che conferma ulteriormente. L’intera catena di conferme è artificiale, ma la coerenza multicanale rende quasi impossibile dubitare della legittimità della richiesta.

Il punto chiave è che l’AI ha eliminato il costo di coordinamento di queste operazioni complesse. Prima, un attacco multicanale richiedeva un team di persone che gestiva ogni canale manualmente. Oggi, un singolo operatore con accesso a strumenti AI può orchestrare l’intera operazione su più canali contemporaneamente, personalizzando ogni interazione in tempo reale.