Casi Studio & Strategie

Claude Sonnet vs opus

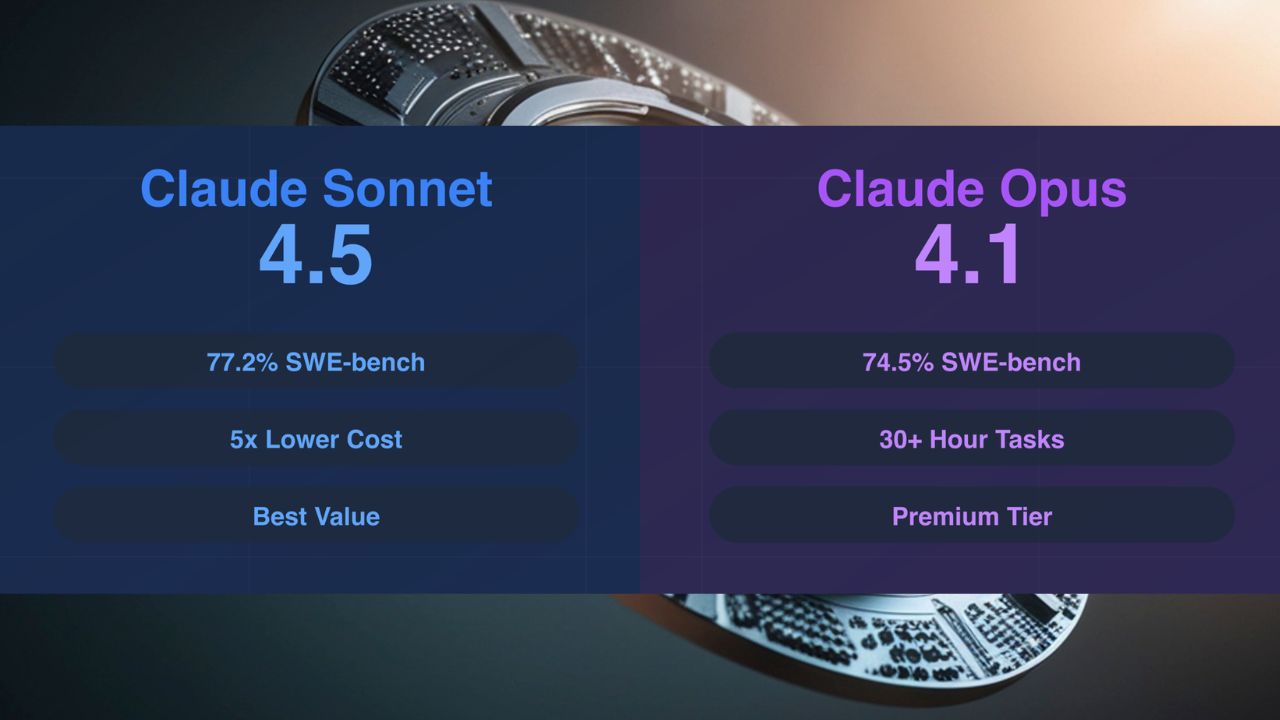

Il divario tra Claude Sonnet e Opus non è mai stato così ridotto — e scegliere il modello sbagliato può significare sprecare migliaia di euro al mese oppure rinunciare a prestazioni critiche. Ad aprile 2026, Claude Sonnet 4.6 si posiziona a soli 1,2 punti percentuali da Opus 4.6 sul benchmark SWE-bench Verified, pur costando cinque volte meno. Gli sviluppatori che hanno testato Sonnet 4.6 lo hanno addirittura preferito al precedente modello di punta Opus 4.5 nel 59% dei casi. Eppure Opus domina ancora nel ragionamento scientifico di livello dottorale, nei flussi di lavoro multi-agente complessi e nell’analisi di intere codebase grazie alla sua finestra di contesto da 1 milione di token.

Questa guida analizza ogni differenza significativa tra Claude Sonnet vs Opus — benchmark, prezzi, velocità, finestra di contesto, prestazioni di coding, profondità di ragionamento, scrittura creativa e casi d’uso reali — per aiutarti a prendere la decisione giusta per il tuo flusso di lavoro specifico. Che tu sia uno sviluppatore indipendente, il CTO di una startup o un architetto enterprise che gestisce milioni di token al giorno, qui troverai il framework decisionale che ti serve.

- La risposta rapida: quale scegliere?

- I modelli a confronto: Sonnet 4.6 e Opus 4.6

- Confronto benchmark: dove il divario è reale

- Analisi dei prezzi e dei costi

- Prestazioni di coding: il divario più piccolo di sempre

- Ragionamento e scienza: dove Opus domina

- Scrittura creativa e contenuti: differenze pratiche

- Confronto velocità e latenza

- Finestra di contesto: 200K vs 1M token

- Agent Teams: il parallelismo esclusivo di Opus

- Quando usare Sonnet: 8 scenari chiari

- Quando usare Opus: 7 scenari che valgono il premium

- L’approccio intelligente: il model routing

- FAQ — Domande frequenti

- Conclusione

La risposta rapida: quale scegliere?

Se puoi ricordare una sola cosa di questo intero articolo: inizia con Sonnet 4.6, passa a Opus 4.6 quando non è sufficiente. La maggior parte degli sviluppatori scoprirà che quel passaggio è raramente necessario.

Gestisce scrittura, analisi, coding, ricerca e lavoro strategico con qualità eccellente a un quinto del prezzo di Opus. Offre il 97–99% delle capacità di coding di Opus, velocità di risposta 2× superiore e il 30% di token in meno per task. Il miglior equilibrio tra costo, velocità e capacità nella lineup di Anthropic.

Prende un vantaggio netto nella scienza di livello dottorale (91,3% GPQA Diamond vs 74,1%), nella risoluzione di problemi inediti (68,8% ARC-AGI-2) e nell’ingegneria multi-step complessa. Funzionalità esclusive: Agent Teams per flussi di lavoro paralleli e finestra di contesto da 1M token per l’analisi di intere codebase.

Usa Sonnet per ampiezza ed efficienza. Passa a Opus quando profondità e precisione sono irrinunciabili. La strategia più intelligente nel 2026 non è sceglierne uno in modo permanente — è fare routing tra i due in base alla complessità del task.

I modelli a confronto: Sonnet 4.6 e Opus 4.6

Sia Claude Sonnet 4.6 che Claude Opus 4.6 sono stati rilasciati a febbraio 2026 come parte della famiglia di modelli Claude 4.6. Condividono la stessa architettura di base e la stessa filosofia di addestramento, ma sono ottimizzati per punti operativi diversi nello spettro capacità-costo-velocità.

Claude Sonnet 4.6 è posizionato come il modello bilanciato e ad alte prestazioni di Anthropic — il cavallo da battaglia progettato per carichi di lavoro in produzione dove l’efficienza dei costi e la velocità contano quanto la qualità. È il modello che Anthropic consiglia come punto di partenza predefinito per la maggior parte dei casi d’uso.

Claude Opus 4.6 è il modello di ragionamento di punta — progettato per i task analitici, scientifici e ingegneristici più impegnativi, dove la qualità è l’unica variabile che conta. Sacrifica velocità ed efficienza dei costi in favore di un ragionamento più profondo, un contesto più ampio e funzionalità esclusive come Agent Teams.

Entrambi i modelli supportano input di testo e immagini, output testuale, capacità multilingue e visione. Entrambi sono disponibili tramite l’API Claude, Amazon Bedrock, Google Vertex AI e Microsoft Foundry. Su claude.ai, entrambi sono accessibili tramite l’abbonamento Pro a 20 $/mese.

Anthropic ha rilasciato Claude Opus 4.7 il 16 aprile 2026 come aggiornamento incrementale di Opus 4.6 con un miglioramento significativo nel coding agentico. Sebbene questo articolo si concentri sul confronto Sonnet vs Opus a livello concettuale, le dinamiche fondamentali — Sonnet per ampiezza ed efficienza, Opus per profondità e ragionamento — rimangono le stesse tra le versioni dei modelli.

Confronto benchmark: dove il divario è reale

I benchmark non raccontano tutta la storia, ma rivelano dove i modelli divergono davvero. Il confronto Claude Sonnet vs Opus sui benchmark standardizzati mostra un pattern chiaro: quasi identici nel coding, drammaticamente diversi nella scienza e nel ragionamento.

| Benchmark | Sonnet 4.6 | Opus 4.6 | Divario | Vincitore |

|---|---|---|---|---|

| SWE-bench Verified (coding) | 79,6% | 80,8% | 1,2 punti | ≈ Pari |

| GPQA Diamond (scienza PhD) | 74,1% | 91,3% | 17,2 punti | Opus |

| ARC-AGI-2 (ragionamento inedito) | — | 68,8% | Significativo | Opus |

| OSWorld (uso del computer) | ~42% | ~42,2% | 0,2 punti | ≈ Pari |

| Efficienza token (stesso task) | Baseline | 19–30% in meno | — | Opus |

| Velocità di risposta | 40–60 tok/s | ~20–30 tok/s | ~2× | Sonnet |

Cosa significano davvero questi numeri

Il divario di 1,2 punti su SWE-bench Verified è il più piccolo nella storia di Claude. Per dare un contesto: Sonnet 4.6 supera ogni modello Opus rilasciato prima della versione 4.5. Per il lavoro di coding pratico — correzione di bug, implementazione di funzionalità, scrittura di test — questo divario è trascurabile.

Il divario sul GPQA Diamond è una storia completamente diversa. Questo benchmark testa il ragionamento scientifico di livello dottorale in fisica, chimica e biologia. La differenza di 17,2 punti è il divario prestazionale più ampio tra i due modelli su qualsiasi benchmark principale. Se il tuo lavoro riguarda il ragionamento scientifico avanzato, l’analisi di ricerca o domande di dominio complesse, Opus opera a un livello fondamentalmente diverso.

Sull’uso del computer e l’automazione GUI (OSWorld), entrambi i modelli hanno prestazioni praticamente identiche — una differenza di 0,2 punti è rumore statistico. Per questi carichi di lavoro, Sonnet è la scelta ovvia poiché costa cinque volte meno per prestazioni effettivamente identiche.

Analisi dei prezzi e dei costi

Il prezzo è dove la decisione Claude Sonnet vs Opus diventa concreta. La struttura dei costi crea un framework chiaro: Sonnet è il default efficiente, Opus è l’upgrade premium a cui ricorrere quando la qualità giustifica la spesa.

| Dimensione prezzo | Sonnet 4.6 | Opus 4.6 |

|---|---|---|

| Token di input (per 1M) | $3,00 | $15,00 |

| Token di output (per 1M) | $15,00 | $75,00 |

| Abbonamento Claude Pro | $20/mese (include entrambi i modelli) | |

| Rapporto di costo | 1× | 5× più costoso |

Costi reali a tre livelli di utilizzo

SVILUPPATORE SINGOLO — ~2M token/mese Sonnet: $36 | Opus: $180 | Risparmio con Sonnet: $144/mese

STARTUP — ~20M token/mese Sonnet: $360 | Opus: $1.800 | Risparmio con Sonnet: $1.440/mese

ENTERPRISE — ~200M token/mese Sonnet: $3.600 | Opus: $18.000 | Risparmio con Sonnet: $14.400/mese

Se si tiene conto dell’efficienza di Opus nei token (19–30% in meno per risultati comparabili), il divario di costo reale si riduce leggermente — ma non abbastanza da cambiare il calcolo fondamentale. Per la maggior parte dei carichi di lavoro, Sonnet offre il 97–99% della qualità al 20% del costo.

Prestazioni di coding: il divario più piccolo di sempre

Il coding è il caso d’uso in cui il dibattito Claude Sonnet vs Opus si fa più acceso — e dove i dati favoriscono più chiaramente Sonnet per la maggior parte degli sviluppatori. Il divario di 1,2 punti su SWE-bench Verified (79,6% vs 80,8%) rappresenta il margine più piccolo mai registrato tra i due livelli.

API CRUD e codice boilerplate — Sonnet produce codice pulito e idiomatico per pattern standard. Opus non aggiunge valore qui. Generazione di test — la scrittura di test unitari per codice esistente è gestita con sicurezza e velocità. Documentazione — Sonnet spiega il codice in modo chiaro con una differenza di qualità trascurabile. Componenti frontend — componenti React, Vue o HTML/CSS rientrano pienamente nel punto di forza di Sonnet. Pair programming iterativo — quando si lavora con scambi rapidi e frequenti, il vantaggio di velocità di Sonnet risulta decisivo.

Refactoring complesso multi-file — progetti che toccano più di 10 file dove mantenere la coerenza nell’intera codebase è critico. Specifiche ambigue — Opus pone domande chiarificatrici migliori e fa ipotesi più difendibili. Decisioni architetturali — progettazione di sistemi dove le scelte strutturali hanno conseguenze a lungo termine. Design di algoritmi inediti — problemi senza pattern evidenti nei dati di addestramento. Debug di problemi di concorrenza — Opus identifica edge case che Sonnet potrebbe perdere.

La raccomandazione pratica dagli sviluppatori che hanno testato entrambi estensivamente: Sonnet per l’80–90% dei task di coding, con escalation a Opus per il restante 10–20% dove il divario di qualità si manifesta effettivamente. Per i team che elaborano milioni di token al giorno su task di coding, questo approccio ibrido riduce i costi del 50–70% rispetto all’uso esclusivo di Opus.

Ragionamento e scienza: dove Opus domina

Se il confronto nel coding è una gara combattuta, il confronto nel ragionamento e nella scienza è una vittoria schiacciante. Questo è il territorio in cui Opus giustifica pienamente il suo prezzo premium — e dove la scelta Claude Sonnet vs Opus diventa chiara e netta.

Il divario di 17,2 punti sul GPQA Diamond non è una differenza marginale — rappresenta un livello di capacità fondamentalmente diverso per il ragionamento a livello di esperto. Opus 4.6 ottiene il 91,3% su problemi che richiedono conoscenze di livello dottorale in fisica, chimica e biologia. Sonnet 4.6 ottiene il 74,1% sugli stessi problemi. Non si tratta di spaccare il capello in quattro — è una differenza qualitativa su ciò che il modello è in grado di gestire.

Dove conta il divario di ragionamento

Per la maggior parte dei task analitici quotidiani — sintetizzare un report, analizzare un dataset, scrivere un documento strategico — la differenza di ragionamento è impercettibile. Entrambi i modelli producono output coerenti e ben strutturati. La separazione diventa visibile solo quando i task superano la zona di comfort e iniziano a stressare l’architettura di ragionamento del modello.

Opus mantiene suddivisioni strutturali più esplicite durante il ragionamento complesso. Esplicita le ipotesi, chiarisce i vincoli e procede attraverso le fasi di ragionamento con disciplina visibile. Questo diventa particolarmente evidente in domini analitici come l’analisi delle politiche, la pianificazione del design di sistemi, le dimostrazioni matematiche con molteplici passaggi intermedi e qualsiasi task in cui la catena di ragionamento supera i cinque-sette passaggi sequenziali.

Se il tuo lavoro riguarda la scoperta di farmaci, la modellazione finanziaria, la ricerca autonoma, l’analisi legale complessa o qualsiasi dominio in cui la precisione a livello di esperto è irrinunciabile, Opus vale ogni centesimo del suo premium. Per tutto il resto, la differenza di ragionamento semplicemente non si manifesta nella pratica.

Scrittura creativa e contenuti: differenze pratiche

La creazione di contenuti è uno dei casi d’uso più comuni per Claude, e le dinamiche Sonnet vs Opus qui sono interessanti. Entrambi i modelli producono una prosa eccellente — ma approcciano la scrittura in modo diverso.

Nei test di confronto diretto, Opus tende verso scelte creative più audaci e energiche, con metafore centrali forti e una qualità da conferenza magistrale. Sonnet tende verso una scrittura più ancorata e sfumata, con una qualità da collega che condivide intuizioni. Nessuno dei due è oggettivamente migliore — dipende da cosa ti serve.

Per la produzione di contenuti ad alto volume — post del blog, descrizioni di prodotto, social media, newsletter — Sonnet offre una qualità indistinguibile a un costo nettamente inferiore e con un throughput più alto. Un team marketing che produce 500 contenuti al mese risparmia circa 300 $ rispetto a Opus senza alcuna differenza di qualità percepibile.

Dove Opus mostra il suo vantaggio nella scrittura è la sintesi: prendere mesi di contesto accumulato, fonti multiple e contrastanti, o input strategici complessi e produrre un documento che dimostra una comprensione genuina delle dinamiche sottostanti. Per documenti strategici per clienti, presentazioni per il consiglio di amministrazione e articoli di thought leadership dove la profondità di analisi conta più della velocità, la capacità di ragionamento aggiuntiva di Opus si traduce in output notevolmente più forti.

Opus sembra un pensatore strategico che sa anche scrivere bene. Sonnet sembra uno scrittore molto talentuoso che segue le istruzioni. — Confronto nel content marketing tra modelli Claude

Confronto velocità e latenza

La velocità è uno dei vantaggi più evidenti di Sonnet. Con circa 40–60 token al secondo, Sonnet è approssimativamente due volte più veloce di Opus nell’uso reale. Questa differenza potrebbe sembrare marginale per una singola interazione, ma si amplifica enormemente in ambienti di produzione.

Per i flussi di lavoro iterativi — pair programming, editing bidirezionale, interazioni con i clienti in tempo reale — la differenza di latenza cambia fondamentalmente l’esperienza. Un vantaggio di velocità 2× significa poter iterare il doppio delle volte nello stesso periodo, il che spesso produce un output finale migliore rispetto a una singola risposta più lenta di Opus.

Per l’elaborazione in batch, la differenza di velocità si traduce direttamente in throughput. Una pipeline che elabora 10.000 documenti con Sonnet si completa nella metà del tempo della stessa pipeline con Opus — a un quinto del costo. Il vantaggio combinato di velocità e costo rende Sonnet la scelta ovvia per qualsiasi flusso di lavoro di elaborazione ad alto volume.

Finestra di contesto: 200K vs 1M token

Opus 4.6 offre una finestra di contesto da 1 milione di token — cinque volte più grande della finestra da 200K token di Sonnet 4.6. Per la maggior parte dei casi d’uso, 200K token (circa 150.000 parole o 500 pagine) sono più che sufficienti. Ma per carichi di lavoro specifici, la finestra da 1M è un vero elemento differenziante.

La finestra da 1M token diventa preziosa quando hai bisogno di analizzare un’intera codebase (50.000+ righe di codice distribuite su centinaia di file), analizzare un portafoglio completo di contratti legali, elaborare un intero corpus di articoli di ricerca, o mantenere il contesto attraverso conversazioni estremamente lunghe. Se il tuo flusso di lavoro richiede di tenere un intero progetto di grandi dimensioni nel contesto simultaneamente, Opus è l’unica opzione.

Per i team che non necessitano di più di 200K token di contesto — che rappresentano la maggioranza — questo non è un motivo per scegliere Opus. 200K token sono già un numero enorme: contengono comodamente un romanzo intero, una specifica tecnica di cento pagine, o decine di migliaia di righe di codice.

Agent Teams: il parallelismo esclusivo di Opus

Agent Teams è una delle funzionalità esclusive più interessanti di Opus 4.6 — e non è disponibile su Sonnet. Agent Teams permette di avviare molteplici istanze di Claude che lavorano contemporaneamente su parti diverse di un progetto, trasformando flussi di lavoro sequenziali in paralleli.

Invece di chiedere sequenzialmente a Claude di scrivere i test, poi refactorizzare un modulo, poi aggiornare la documentazione, puoi inviare tutti e tre i task in parallelo: un agente scrive i test unitari mentre un altro refactorizza il modulo sottostante; un agente migra gli schemi del database mentre un altro aggiorna il layer ORM; un agente costruisce l’API mentre un altro costruisce l’integrazione frontend.

Agent Teams offre il massimo valore nei progetti grandi con workstream indipendenti. Se stai lavorando su un task focalizzato su un singolo file, Agent Teams non porta alcun beneficio. Ma per una funzionalità importante che tocca molteplici moduli, parallelizzare il lavoro può ridurre significativamente il tempo totale di completamento.

Agent Teams è la funzionalità che separa più chiaramente i due modelli per i flussi di lavoro di sviluppo professionale. Se i tuoi progetti coinvolgono regolarmente modifiche coordinate su molteplici codebase, microservizi o sistemi di documentazione, Agent Teams da solo può giustificare il premium di Opus attraverso il risparmio di tempo — anche se Sonnet gestirebbe ogni singolo task altrettanto bene.

Quando usare Sonnet: 8 scenari chiari

Coding e sviluppo quotidiano

Correzione di bug, implementazione di funzionalità, scrittura di test, code review, generazione di boilerplate. Il 97–99% della qualità di Opus al 20% del costo.

Produzione di contenuti ad alto volume

Post del blog, descrizioni di prodotto, campagne email, contenuti per i social media. Qualità indistinguibile a un costo 5× inferiore e velocità 2× superiore.

Estrazione dati e classificazione

Parsing di documenti, estrazione di dati strutturati, categorizzazione di testo. Velocità ed efficienza dei costi dominano; la differenza di qualità è trascurabile.

Chatbot e supporto clienti

La latenza inferiore significa risposte più rapide per gli utenti finali. La qualità è eccellente per l’AI conversazionale. Il vantaggio di velocità migliora l’esperienza utente.

Uso del computer e automazione GUI

Entrambi i modelli hanno prestazioni identiche su OSWorld (differenza di 0,2 punti). Sonnet a un quinto del costo è la scelta ovvia.

Sintesi e analisi

Riassunti di report, appunti di riunione, analisi documentale. Il divario di ragionamento non si manifesta sui task analitici standard.

Pair programming iterativo

Quando il flusso di lavoro prevede scambi rapidi con frequenti affinamenti, il vantaggio di velocità di Sonnet si moltiplica ad ogni iterazione.

Produzione con budget limitato

Startup e team con budget API limitati. Sonnet sfrutta ogni euro cinque volte meglio con un compromesso di qualità minimo.

Quando usare Opus: 7 scenari che valgono il premium

Ragionamento scientifico di livello dottorale

Scoperta di farmaci, simulazioni fisiche, analisi chimica, ricerca biologica. Il divario di 17,2 punti su GPQA Diamond è una differenza di capacità qualitativa.

Architettura e progettazione di sistemi complessi

Decisioni con conseguenze strutturali a lungo termine su sistemi multi-servizio. Opus individua edge case e fa scelte progettuali più difendibili.

Analisi di intere codebase (contesto 1M)

Analizzare oltre 50.000 righe di codice distribuite su centinaia di file contemporaneamente. Possibile solo con la finestra di contesto da 1M token di Opus.

Flussi di lavoro paralleli con Agent Teams

Sviluppo di funzionalità multi-modulo, refactoring coordinato, cicli simultanei di test e implementazione. Funzionalità esclusiva di Opus.

Modellazione finanziaria e analisi del rischio

Ragionamento quantitativo ad alto rischio dove la tolleranza all’errore è vicina allo zero. La catena di ragionamento più profonda di Opus riduce il rischio di errori di calcolo sottili.

Documenti di sintesi strategica

Presentazioni strategiche per clienti che sintetizzano mesi di contesto. Report a livello di consiglio di amministrazione dove la profondità dell’analisi impatta direttamente le decisioni.

Risoluzione di problemi inediti senza pattern chiaro

Problemi al di fuori della distribuzione dei dati di addestramento dove il ragionamento creativo è essenziale. Il punteggio ARC-AGI-2 di Opus (68,8%) riflette un vantaggio genuino in quest’area.

L’approccio intelligente: il model routing

I sistemi di produzione più sofisticati nel 2026 non scelgono tra Sonnet e Opus — li usano entrambi, instradando le richieste dinamicamente in base alla complessità del task. Questo approccio cattura il meglio di entrambi i mondi: l’efficienza di Sonnet per la maggioranza dei task, la profondità di Opus per la minoranza che la richiede.

SEMPLICE → Haiku 4.5 (~15% del traffico) $0,80/$4 per MTok STANDARD → Sonnet 4.6 (~70% del traffico) $3/$15 per MTok COMPLESSO → Opus 4.6 (~15% del traffico) $15/$75 per MTok

RISULTATO: 55% di risparmio rispetto all’uso esclusivo di Opus Calo di qualità: impercettibile per l’85% delle richieste

Il pattern di routing è semplice: classifica ogni richiesta in entrata per complessità, poi instradala verso il modello appropriato. Classificazione semplice, estrazione e risposte brevi vanno a Haiku. Coding standard, scrittura e analisi vanno a Sonnet. Ragionamento complesso, ingegneria multi-step e analisi ad alto rischio vanno a Opus. Il cambio del modello è un singolo campo nell’API — nessuna modifica architetturale necessaria.

Questo approccio a tre livelli è diventato lo standard del settore per i team che elaborano volumi significativi di token. Il risparmio del 55% rispetto all’instradamento di tutto tramite Opus non comporta alcun degrado misurabile della qualità sull’85% delle richieste che non richiedono il livello di ragionamento di Opus.

FAQ — Domande frequenti

Per la maggior parte dei task di coding, Sonnet 4.6 offre il 97–99% delle capacità di Opus a un quinto del costo. Sonnet gestisce eccellentemente la correzione di bug, l’implementazione di funzionalità, i test e i componenti frontend. Opus si distingue nel refactoring complesso multi-file, nelle specifiche ambigue, nelle decisioni architetturali e nel design di algoritmi inediti. Il divario su SWE-bench Verified è di soli 1,2 punti percentuali (79,6% vs 80,8%).

Opus costa 5× di più: $15/$75 per milione di token (input/output) contro i $3/$15 di Sonnet. Tuttavia, Opus usa il 19–30% di token in meno per task comparabili, quindi la differenza di costo effettiva è più vicina a 3,5–4×. Su claude.ai, entrambi sono inclusi nell’abbonamento Pro da $20/mese.

Sì. Claude Pro a $20/mese include l’accesso a Haiku, Sonnet e Opus. Puoi passare da un modello all’altro nell’interfaccia web. L’abbonamento non limita quale modello usi — limita il volume totale di utilizzo tra tutti i modelli.

Sonnet è circa 2× più veloce di Opus, producendo 40–60 token al secondo contro i ~20–30 token al secondo di Opus. Questa differenza è significativa per i flussi di lavoro iterativi e i requisiti di latenza in produzione.

Agent Teams è una funzionalità esclusiva di Opus che permette di avviare molteplici istanze di Claude che lavorano su parti diverse di un progetto in parallelo. Non è disponibile su Sonnet. Agent Teams è più utile per grandi progetti con workstream indipendenti — refactoring coordinato, test e implementazione simultanei, sviluppo di funzionalità multi-modulo.

Opus 4.6 ha una finestra di contesto da 1 milione di token; Sonnet 4.6 ha 200K token. Per la maggior parte dei task, 200K (circa 500 pagine) sono più che sufficienti. La finestra da 1M è importante per l’analisi di intere codebase, grandi portafogli documentali o conversazioni estremamente lunghe.

Ragionamento scientifico di livello dottorale (91,3% vs 74,1% su GPQA Diamond), risoluzione di problemi inediti (ARC-AGI-2), catene di ragionamento multi-step complesse che superano 5–7 passaggi sequenziali, analisi di intere codebase e flussi di lavoro paralleli con Agent Teams. Sono scenari specifici e ad alta complessità — non task quotidiani.

Per l’uso API in produzione, il pattern di routing (15% Haiku, 70% Sonnet, 15% Opus) risparmia ~55% rispetto all’uso esclusivo di Opus senza perdita di qualità misurabile sui task non complessi. Per l’uso individuale su claude.ai, basta iniziare con Sonnet e passare a Opus quando un task specifico lo richiede.

Per l’80–90% dei casi d’uso, sì. Gli sviluppatori nei test di Anthropic hanno preferito Sonnet 4.6 al precedente Opus 4.5 nel 59% dei casi. Il restante 10–20% dove Opus aggiunge valore genuino — scienza avanzata, architettura complessa, Agent Teams, contesto 1M — giustifica il mantenimento di Opus come opzione di escalation.

Opus 4.7, rilasciato il 16 aprile 2026, offre un miglioramento significativo nel coding agentico rispetto a Opus 4.6. La dinamica fondamentale resta: Sonnet per ampiezza ed efficienza, Opus per profondità e ragionamento di frontiera. Il divario sui task di coding standard potrebbe essersi leggermente ampliato con la 4.7, ma per il lavoro di sviluppo quotidiano, Sonnet resta il default efficiente in termini di costi.

Conclusione

La decisione Claude Sonnet vs Opus nel 2026 non riguarda quale modello sia “più intelligente”. Entrambi operano a livello di frontiera. La decisione riguarda quale modello offre il giusto equilibrio tra profondità di ragionamento, velocità ed efficienza dei costi per i task che esegui effettivamente.

I dati sono inequivocabili: Sonnet 4.6 dovrebbe essere il modello predefinito per la maggior parte degli sviluppatori, scrittori e team. Offre il 97–99% delle capacità di coding di Opus a un quinto del costo e al doppio della velocità. Gestisce scrittura, analisi, sintesi e lavoro di sviluppo standard con qualità eccellente. È stato preferito dagli sviluppatori rispetto alla generazione precedente di Opus nei test in cieco.

Opus guadagna il suo premium in un sottoinsieme specifico ma importante di scenari: scienza di livello dottorale, architettura complessa, analisi di intere codebase con la finestra da 1M token, flussi di lavoro paralleli con Agent Teams e ragionamento ad alto rischio dove la tolleranza all’errore è vicina allo zero. Per questi task, la differenza di prezzo è irrilevante — ciò che conta è il tetto di qualità.

Il compromesso non è binario. È condizionale. Inizia con Sonnet, passa a Opus quando non è sufficiente. La maggior parte dei team scoprirà che il passaggio è raramente necessario — e quando lo è, vale ogni centesimo. — Il framework pratico per la scelta del modello Claude nel 2026

La strategia più intelligente non è sceglierne uno in modo permanente. È sapere quando ciascun modello eccelle e fare routing di conseguenza. Per gli utenti individuali su claude.ai: inizia ogni conversazione con Sonnet, passa a Opus quando il task lo richiede davvero. Per gli utenti API in produzione: implementa il pattern di routing a tre livelli e risparmia il 55% mantenendo la qualità dove conta.

-

Casi Studio & Strategie2 mesi ago

Casi Studio & Strategie2 mesi agoAffiliate Marketing 2026: Perché l’AI cambierà tutto

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCreare video con intelligenza artificiale gratis

-

Casi Studio & Strategie4 giorni ago

Casi Studio & Strategie4 giorni agoIA per Creare Immagini

-

Software & Tool AI6 giorni ago

Software & Tool AI6 giorni agoMusica con AI: Guida Completa ai Migliori Strumenti per Creare Canzoni con l’Intelligenza Artificiale nel 2026

-

Casi Studio & Strategie6 giorni ago

Casi Studio & Strategie6 giorni agoRicerca Generativa: Come l’AI Sta Rivoluzionando Google e Cosa Cambia per il Tuo Sito nel 2026

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCome l’intelligenza artificiale sta influenzando gli attacchi informatici

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCome attivare intelligenza artificiale su iphone

-

Software & Tool AI6 giorni ago

Software & Tool AI6 giorni agoSEO AI Free Tools: I Migliori Strumenti Gratuiti per Ottimizzare il Tuo Sito con l’Intelligenza Artificiale nel 2026