Software & Tool AI

Musica con AI: Guida Completa ai Migliori Strumenti per Creare Canzoni con l’Intelligenza Artificiale nel 2026

Nel 2026 la musica con AI non è più una curiosità da laboratorio — è la nuova normalità dell’industria musicale globale. Chiunque disponga di uno smartphone può generare una canzone completa, con voce sintetica, arrangiamento orchestrale e mix professionale, in meno di sessanta secondi. Strumenti come Suno AI, Udio, MusicGen e Stable Audio hanno abbattuto la barriera tecnica tra l’idea e la produzione, ridisegnando in modo radicale i confini tra compositore, producer, ascoltatore e macchina. Questa guida completa risponde a tutte le domande sulla musica con AI: cos’è, come funziona, quali sono i migliori strumenti del 2026, come impatta artisti e industria, quali opportunità crea e quali rischi porta con sé.

I numeri della rivoluzione parlano chiaro: nel 2026 oltre 15 milioni di brani generati dall’AI vengono caricati ogni mese sulle piattaforme di streaming. Il mercato globale degli strumenti AI per la musica ha superato i 3,5 miliardi di dollari e cresce al ritmo del 28% annuo. Il 40% dei producer professionisti dichiara di usare almeno uno strumento AI nel proprio flusso di lavoro. Eppure il dibattito su copyright, autorialità e futuro del lavoro creativo non è mai stato così acceso.

- Cos’è la musica con AI e perché cambia tutto

- Come funziona tecnicamente: modelli, training e generazione

- I numeri del settore: statistiche chiave 2026

- I migliori strumenti AI per la musica nel 2026

- Casi d’uso: chi usa la musica con AI e come

- Come iniziare: guida passo-passo per principianti

- Qualità, limiti e cosa l’AI non può (ancora) fare

- Copyright, diritti e proprietà intellettuale

- Impatto sull’industria musicale: rischi e opportunità

- Cosa cambia per artisti e musicisti professionisti

- Confronto tra i principali strumenti AI per la musica

- FAQ — Domande frequenti

- Conclusione

Cos’è la musica con AI e perché cambia tutto

La musica con AI è la creazione, composizione, arrangiamento, produzione o modifica di musica attraverso sistemi di intelligenza artificiale. Invece di richiedere anni di formazione musicale o l’accesso a costosi studi di registrazione, questi sistemi permettono a chiunque di generare brani completi a partire da una semplice descrizione testuale — un processo noto come text-to-music — oppure di trasformare, estendere o remixare musica esistente attraverso prompt e parametri.

Nella pratica, un utente può scrivere “crea una canzone pop malinconica con piano e voce femminile, testo sull’estate passata” e ricevere in pochi secondi un brano di tre minuti completo di struttura verse-chorus-bridge, voce sintetica e mix pronto per lo streaming. Oppure un producer professionista può usare l’AI per generare varianti di una linea di basso, isolare strumenti da un audio esistente, o comporre automaticamente un underscore per un video senza bisogno di un compositore esterno.

L’impatto di questa tecnologia è duplice. Da un lato, democratizza radicalmente la creazione musicale: il talento tecnico non è più il filtro principale tra l’idea e l’esecuzione. Dall’altro, mette in discussione i modelli economici, le strutture di copyright e il valore stesso della musica come espressione umana. Per l’industria musicale — un settore che ha già attraversato la rivoluzione digitale, il peer-to-peer e lo streaming — l’AI rappresenta il cambiamento più profondo nella storia moderna della musica.

L’AI non toglierà il lavoro ai musicisti bravi — toglierà il lavoro a quelli mediocri e aprirà la porta a chi non ha mai avuto accesso agli strumenti. La vera domanda non è se usarla, ma come usarla bene. — Il nuovo paradigma della produzione musicale nel 2026

Nel 2026 la musica con AI non è più una categoria a sé: è diventata parte integrante dell’ecosistema musicale. Le major discografiche hanno divisioni AI interne. Le piattaforme di streaming come Spotify hanno integrato strumenti di generazione AI nelle loro app. I videogiochi, i podcast, i video di YouTube e i contenuti dei social media usano musica generata dall’AI come standard, non come eccezione.

Come funziona tecnicamente: modelli, training e generazione

I sistemi di musica con AI moderni si basano su due grandi famiglie di approcci tecnici: i modelli di diffusione (diffusion models) e i modelli autoregressivi basati su trasformatori (transformer-based autoregressive models). Comprendere le differenze aiuta a scegliere lo strumento giusto e a interpretarne le capacità e i limiti.

Generano la musica token per token, come se “componessero” nota dopo nota in sequenza. Ottimi per coerenza strutturale e brani con sviluppo narrativo. Suno AI e MusicGen usano questo approccio. Tendono a essere più lenti ma producono output più coerenti sul lungo termine.

Partono da rumore casuale e lo “raffinano” progressivamente fino a ottenere audio coerente. Stable Audio e Riffusion usano questo approccio. Sono particolarmente efficaci per texture sonore, ambienti e suoni strumentali dettagliati.

Combinano entrambi gli approcci. Udio, ad esempio, usa una pipeline ibrida che genera prima una struttura musicale latente e poi la “renderizza” in audio di alta qualità tramite diffusione. Rappresentano lo stato dell’arte nel 2026.

Il processo di training: su cosa impara l’AI

Tutti i sistemi di musica con AI vengono addestrati su enormi dataset di brani musicali. Questi dataset includono file audio (in formato grezzo o convertiti in rappresentazioni spettrali), metadati come genere, strumentazione, BPM e tonalità, e in alcuni casi testi e partiture. Durante il training, il modello apprende i pattern statistici della musica: come si struttura un verso, cosa rende un accordo consonante o dissonante, come evolvono le energie di un brano, quali strumenti suonano bene insieme.

Il punto critico è che questi dataset includono spesso musica protetta da copyright, il che ha generato numerose controversie legali — di cui si parla in dettaglio nella sezione dedicata al copyright. Nel 2026, i principali provider hanno risposto sviluppando dataset “puliti” con musica royalty-free o con licenza esplicita, ma la questione è ancora in evoluzione.

Da testo a suono: il processo di generazione

Quando un utente inserisce un prompt testuale come “jazz notturno con sassofono e pioggia”, il sistema esegue una serie di operazioni: il testo viene codificato in un embedding vettoriale che cattura il significato semantico del prompt; il modello genera una rappresentazione latente della musica corrispondente; questa rappresentazione viene decodificata in forme d’onda audio digitale; infine il risultato viene elaborato con post-processing per migliorare la qualità percepita. L’intero processo richiede da 5 a 60 secondi in base alla lunghezza del brano e alla complessità del modello.

I numeri del settore: statistiche chiave 2026

Per capire la portata della rivoluzione della musica con AI, è necessario guardare i dati. Le statistiche del 2026, raccolte da fonti come Goldman Sachs, MIDIA Research e i report annuali delle principali piattaforme, delineano un quadro di trasformazione profonda e accelerata.

Oltre 15 milioni di brani generati o co-generati dall’AI vengono caricati ogni mese sulle piattaforme di streaming globali. Spotify ha dichiarato che il 10% dei nuovi caricamenti sulla piattaforma proviene da sistemi AI, una percentuale destinata a crescere. DistroKid, uno dei principali distributori indie, ha introdotto flag specifici per i contenuti AI dopo che il volume ha reso impossibile ignorare il fenomeno.

Il mercato globale degli strumenti AI per la musica ha superato i 3,5 miliardi di dollari nel 2025 e si prevede raggiunga i 6 miliardi entro il 2028. I segmenti in crescita più rapida sono la generazione text-to-music (per creator e content creator), gli strumenti di mastering e mix automatici (per producer indie), e i sistemi di generazione adattiva per videogiochi e applicazioni interattive.

Sul fronte dell’adozione professionale, il 40% dei producer musicali dichiara di usare almeno uno strumento AI nel proprio flusso di lavoro — un dato che sale al 65% tra i producer under 30. La resistenza è maggiore tra i musicisti classici e i cantautori tradizionali, dove l’adozione è ancora sotto il 20%, ma anche qui la tendenza è in crescita.

Il dato forse più significativo riguarda il copyright e le royalty: si stima che ogni anno i sistemi AI generino contenuti musicali che “competono” con artisti umani per oltre 1 miliardo di dollari in royalty di streaming. Questa cifra ha spinto le major discografiche, i collettivi di artisti e i legislatori a cercare soluzioni urgenti per regolamentare il settore.

I migliori strumenti AI per la musica nel 2026

Il panorama degli strumenti di musica con AI si è consolidato nel 2026 attorno a una manciata di player dominanti, ciascuno con punti di forza specifici. La scelta dello strumento dipende dall’obiettivo: generazione da zero, assistenza nella produzione, mastering automatico o creazione di library music.

Suno AI — Il più accessibile

Suno AI è il punto di riferimento per la generazione text-to-music destinata ai non esperti. Inserendo un semplice prompt testuale, produce brani completi di testo cantato, voce sintetica convincente e arrangiamento strumentale. La versione Pro offre generazione di brani fino a 4 minuti, stili personalizzabili e download in alta qualità. Nel 2026 ha superato i 10 milioni di utenti attivi mensili. Il limite principale è la scarsa controllabilità del risultato: si ottiene ciò che l’AI decide, con poca possibilità di intervento granulare.

Udio — La qualità audio superiore

Udio si è posizionato come alternativa a Suno per chi cerca qualità audio più elevata e maggior fedeltà stilistica. Il sistema permette di specificare dettagli come tonalità, tempo, strumentazione e mood con più precisione. I risultati sono spesso indistinguibili da produzioni umane indie in termini di qualità audio grezza. Udio è preferito dai creator professionisti e da chi usa la musica AI come punto di partenza per ulteriori lavorazioni in DAW.

Stable Audio — Per sound design e musica strumentale

Developed da Stability AI, Stable Audio è il riferimento per la generazione di musica strumentale, texture sonore e sound design. Il modello di diffusione su cui si basa eccelle nella creazione di ambienti sonori, underscore cinematografici e suoni atmosferici. È lo strumento preferito da sound designer, compositori per media e producer di musica elettronica. La versione Pro permette il controllo di segmenti specifici tramite audio condizionante.

Adobe Podcast + Project Music GenAI Control

Adobe ha integrato la generazione musicale AI nella propria suite Creative Cloud tramite il Project Music GenAI Control. Lo strumento permette di generare musica direttamente all’interno di Premiere Pro e Audition, sincronizzata automaticamente alla timeline del video. È la soluzione preferita dai video editor che necessitano di musica originale royalty-free senza uscire dall’ecosistema Adobe.

AIVA — Per composizione classica e orchestrale

AIVA (Artificial Intelligence Virtual Artist) si specializza nella composizione orchestrale, colonne sonore e musica neo-classica. A differenza degli altri strumenti, AIVA genera partiture MIDI modificabili oltre all’audio finale, rendendolo adatto ai compositori che vogliono usare l’AI come punto di partenza per poi lavorare la composizione manualmente in una DAW.

Strumenti per la produzione assistita

Oltre alla generazione pura, esistono strumenti AI che assistono nella produzione musicale tradizionale: iZotope Ozone e Neutron usano l’AI per mastering e mixing automatici con risultati di livello professionale. LANDR offre mastering AI accessibile a chiunque. Splice AI suggerisce sample e loop basandosi sul materiale già caricato dall’utente. Plugin Alliance ha integrato moduli AI in quasi tutti i suoi plugin di processing.

Casi d’uso: chi usa la musica con AI e come

La musica con AI trova applicazione in contesti molto diversi, ciascuno con esigenze e approcci specifici. Comprendere i principali casi d’uso aiuta a valutare quali strumenti siano più adatti alla propria situazione.

YouTuber, podcaster e tiktoker usano la musica AI per creare colonne sonore originali, evitando i problemi di copyright con la musica licenziata. La personalizzazione del mood e dello stile al singolo contenuto è il principale vantaggio.

I sistemi di musica adattiva AI generano colonne sonore dinamiche che si modificano in tempo reale in risposta alle azioni del giocatore, senza costi di composizione e registrazione tradizionale.

Le agenzie usano la musica AI per creare jingle, spot e sonorizzazioni personalizzate per ogni campagna, con tempi e costi ridotti rispetto alla commissione a compositori tradizionali.

I producer professionisti integrano l’AI nel workflow per generare bozze rapide, varianti di arrangiamento, parti strumentali aggiuntive e ispirazioni da sviluppare manualmente in DAW.

I cantautori senza accesso a strumentisti usano la musica AI per creare backing track completi, demo professionali e produzioni finali per distribuire sulle piattaforme di streaming.

App di meditazione, terapia musicale e benessere usano sistemi AI per generare musica personalizzata in tempo reale, adattata allo stato emotivo dell’utente tramite biofeedback.

Come iniziare: guida passo-passo per principianti

Iniziare a fare musica con AI non richiede conoscenze tecniche pregresse. Ecco una guida pratica in dieci passi per chi parte da zero.

Scegli lo strumento giusto al tuo livello

Per iniziare senza esperienza musicale, Suno AI è il punto di partenza ideale: ha un’interfaccia semplice, funziona da browser, e offre un piano gratuito con un numero generoso di generazioni giornaliere. Se hai già esperienza di produzione musicale, valuta Udio o Stable Audio per output di qualità superiore.

Impara l’arte del prompt musicale

La qualità dell’output dipende enormemente dalla qualità del prompt. Un buon prompt musicale specifica: genere (“lo-fi hip hop”), strumentazione (“piano, contrabbasso, batteria spazzolata”), mood (“malinconico, notturno”), tempo (“80 BPM”), e contesto (“per studiare in silenzio”). Più sei specifico, migliore sarà il risultato.

Genera più varianti e seleziona la migliore

Non fermarti alla prima generazione. Usa lo stesso prompt per generare 4-6 varianti e scegli quella che si avvicina di più alla tua visione. La variabilità tra generazioni è alta — il miglior risultato raramente arriva al primo tentativo.

Usa il remix e la continuazione

La maggior parte degli strumenti permette di “estendere” un brano generato o di generare una continuazione stilisticamente coerente. Usa questa funzione per aggiungere un bridge, un outro o una variazione. Puoi anche caricare un brano esistente e chiedere all’AI di generare una continuazione nello stesso stile.

Importa in una DAW per la finitura

Se vuoi un controllo professionale sul risultato, importa l’audio generato in una DAW (GarageBand, Ableton, Logic Pro) per aggiustamenti di editing, EQ, compressione e mix finale. Il materiale AI è un punto di partenza, non necessariamente il prodotto finito.

Verifica la licenza prima di pubblicare

Prima di caricare la musica su piattaforme di streaming o usarla in video commerciali, verifica la licenza del servizio AI usato. Suno e Udio offrono piani commerciali che concedono diritti sull’output. Il piano gratuito di solito permette solo uso personale non commerciale.

Sperimenta con stili ibridi e fusion

Uno dei punti di forza della musica AI è la capacità di combinare stili in modo impossibile o costoso con strumentisti umani. Prompt come “jazz funk con elementi di musica balinese e synth anni ’80” producono risultati che aprono spazi creativi completamente nuovi.

Usa l’AI per superare il blocco creativo

Anche i musicisti esperti usano la musica AI non come prodotto finale, ma come generatore di idee. Genera 10 riff di chitarra AI, ascoltali rapidamente, e usa quello che ti ispira come punto di partenza per una composizione originale. L’AI come strumento di brainstorming è uno dei suoi usi più potenti.

Costruisci una libreria di prompt funzionanti

Quando trovi un prompt che produce risultati eccellenti, salvalo. Nel tempo costruirai una libreria personale di “ricette” per diversi mood, stili e contesti. Questa risorsa diventa progressivamente più preziosa man mano che accumuli esperienza con lo strumento.

Segui l’evoluzione degli strumenti

Il settore della musica con AI evolve ogni tre-sei mesi. Iscriviti alle newsletter dei principali strumenti, segui la community su Reddit (r/SunoAI, r/ArtificialIntelligence) e testa regolarmente le nuove versioni. Le capacità disponibili oggi saranno superate in pochi mesi.

Qualità, limiti e cosa l’AI non può (ancora) fare

Nonostante i progressi straordinari, la musica con AI del 2026 presenta ancora limiti significativi che è importante conoscere per usarla in modo efficace e realistico.

Cosa l’AI fa bene

I sistemi attuali eccellono nella generazione di atmosfere e mood: un brano ambient, un jazz lounge o una ballad pop vengono prodotti con qualità spesso sorprendente. Sono ottimi per la produzione in volume: generare 50 varianti di un tema per un progetto richiede minuti, non giorni. Funzionano bene per stili ben rappresentati nel training data: pop, hip hop, rock classico, jazz, musica classica occidentale. Il mastering automatico ha raggiunto livelli professionali per la musica da streaming.

I limiti attuali

L’AI fatica con la struttura narrativa prolungata: un brano di 8 minuti con sviluppo tematico coerente e climax emotivo calibrato rimane oltre le capacità attuali. La personalità artistica unica è difficile da replicare: l’AI produce buona musica “di genere”, ma la voce artistica inconfondibile di un grande artista è ancora fuori portata. Le micro-imperfezioni espressive dei musicisti umani — il vibrato leggermente impreciso che commuove, la rispira prima del verso — sono difficili da simulare in modo convincente. La musica di tradizioni non occidentali o di nicchia è scarsamente rappresentata nei dataset e i risultati sono spesso mediocri.

Nel 2025, esperimenti condotti da ricercatori dell’Università di Oxford hanno dimostrato che ascoltatori non esperti non distinguono musica AI da musica umana nel 68% dei casi per brani pop e nel 54% per jazz. Tra musicisti professionisti, la percentuale di riconoscimento corretto sale all’82% per il jazz, ma rimane al 61% per il pop. Il divario di qualità percepita si sta chiudendo rapidamente.

Copyright, diritti e proprietà intellettuale

Il tema del copyright nella musica con AI è il più complesso e dibattuto del settore nel 2026. Tocca tre questioni distinte: il diritto sul training data usato per addestrare i modelli, la titolarità dei diritti sull’output generato, e la tutela degli artisti umani dalla concorrenza dell’AI.

Il training data e i contenziosi in corso

I principali sistemi di musica AI sono stati addestrati su dataset che includono milioni di brani protetti da copyright senza licenza esplicita degli artisti. Nel 2023-2024 sono stati avviati contenziosi significativi: Universal Music Group, Sony Music e Warner Music hanno citato in giudizio Suno AI e Udio per violazione del copyright sul training data. A inizio 2026, i casi sono ancora in corso, ma alcuni si sono già risolti con accordi riservati che prevedono compensazioni per le major.

In risposta, i principali strumenti hanno sviluppato dataset alternativi con musica royalty-free o licenziata, e alcune piattaforme offrono ora versioni dei loro modelli addestrate esclusivamente su musica con licenza esplicita — con qualità inferiore ma meno esposizione legale.

Chi possiede i diritti sull’output?

La situazione giuridica sull’output AI varia significativamente per paese. Negli USA, il Copyright Office ha stabilito che i contenuti generati interamente da AI non sono proteggibili da copyright in assenza di apporto creativo umano significativo. Nell’UE, l’AI Act del 2024 ha introdotto l’obbligo di disclosure per i contenuti AI ma non ha risolto la questione della titolarità. In pratica, chi pubblica musica AI deve verificare le condizioni d’uso dello strumento usato: Suno e Udio concedono licenze diverse ai piani gratuiti e a pagamento.

Caricare musica generata da AI su piattaforme come Spotify o YouTube con claim di copyright come se fosse musica originale è una pratica rischiosa e in molti casi illegale. Le piattaforme hanno implementato sistemi di detection per identificare l’AI-generated content e rimuovere i claim impropri. In alcuni casi documentati nel 2025, account sono stati sospesi e royalty accumulate sono state trattenute.

La strada sicura è usare strumenti con licenza commerciale chiara (come i piani Pro di Suno o Udio), dichiarare trasparentemente l’uso dell’AI nei metadati del brano dove richiesto, e non avanzare claim di copyright sull’output. La musica AI può essere distribuita legalmente su streaming come contenuto senza copyright claim, il che consente comunque la monetizzazione tramite advertising sulle piattaforme che lo permettono.

Impatto sull’industria musicale: rischi e opportunità

L’industria musicale globale genera circa 26 miliardi di dollari di ricavi annui da streaming, vendite fisiche e diritti. L’ingresso massiccio della musica con AI ridisegna le dinamiche di questo mercato in modo accelerato, con impatti sia positivi che negativi per i diversi attori del settore.

L’impatto sullo streaming

Il principale effetto già visibile è la proliferazione di contenuti AI sulle piattaforme di streaming. Spotify ha segnalato che una percentuale crescente dei caricamenti sulla piattaforma proviene da sistemi automatizzati — un fenomeno noto come “stream farming AI”. Nel 2024 Spotify ha rimosso oltre 7 milioni di brani AI generati considerati fraudolenti. Nel 2026 ha introdotto un sistema di etichettatura obbligatoria per i contenuti AI e ha modificato le sue politiche di royalty per limitare i pagamenti ai brani con meno di 1.000 stream mensili — una misura che colpisce principalmente il contenuto AI di bassa qualità usato per generare micro-royalty in modo fraudolento.

Il cambiamento nei modelli di business

L’AI sta erodendo i mercati tradizionali della library music e della sync licensing: invece di pagare centinaia o migliaia di euro per licenziare un brano per un video o una pubblicità, molte aziende generano ora musica personalizzata con l’AI a costo quasi zero. Questo colpisce direttamente i compositori che si occupavano di questi segmenti. Allo stesso tempo, crea nuove opportunità: la domanda totale di musica è aumentata grazie alla proliferazione di contenuti digitali, e chi sa integrare l’AI nel proprio workflow può servire più clienti con meno risorse.

Le major discografiche e il paradosso AI

Le major discografiche sono impegnate contemporaneamente su due fronti opposti: citano in giudizio le aziende AI per l’uso non autorizzato del loro catalogo, e investono contemporaneamente nelle stesse tecnologie per usarle internamente. Universal Music Group ha un intero laboratorio AI che usa per produzione, discovery di nuovi talenti e protezione del catalogo. Il paradosso riflette la comprensione dell’industria che questa tecnologia non può essere arrestata — può solo essere controllata, indirizzata e sfruttata.

Cosa cambia per artisti e musicisti professionisti

Per i musicisti professionisti, la musica con AI è sia una minaccia che una opportunità, e la risposta giusta dipende fortemente dalla nicchia in cui si opera e dal tipo di valore che si offre.

I segmenti più esposti sono quelli dove il valore principale era la produzione tecnica piuttosto che la creatività o la performance: session musician per produzioni standard, compositori di library music generica, sound designer per spot di secondo livello. In questi ambiti, l’AI ha già compresso significativamente i compensi e ridotto la domanda di lavoro umano.

I segmenti più protetti sono quelli dove il valore è inscindibile dall’umanità dell’artista: concerti dal vivo e performance, la narrativa personale di un cantautore autentico, la relazione diretta fan-artista, le nicchie di virtuosismo tecnico dove la perfezione esecutiva umana ha valore culturale specifico. Un concerto di un artista amato non può essere sostituito da un’AI — il pubblico paga per essere nella stessa stanza con quella persona specifica in quel momento specifico.

L’AI non ha ancora scritto una canzone che faccia piangere qualcuno per una ragione personale. Il giorno in cui lo farà, non sarà perché è diventata umana — sarà perché siamo diventati noi più bravi a programmarla. — Riflessione sul futuro della creatività musicale

La strategia più efficace per i musicisti nel 2026 è l’integrazione selettiva: usare l’AI per accelerare le parti del processo produttivo a basso valore aggiunto (generazione di bozze, test di arrangiamenti, mastering preliminare) per liberare tempo ed energia per ciò che l’AI non può fare: la visione artistica, la connessione emotiva autentica, la performance dal vivo, la costruzione di una comunità di fan.

Confronto tra i principali strumenti AI per la musica

| Strumento | Punto di forza | Limite principale | Ideale per | Prezzo base |

|---|---|---|---|---|

| Suno AI | Facilità d’uso, voce sintetica | Poco controllo sull’output | Principianti, creator | Gratis / $10/mese |

| Udio | Qualità audio, stile avanzato | Curva di apprendimento | Creator pro, producer | Gratis / $12/mese |

| Stable Audio | Sound design, texture | Meno adatto ai brani vocali | Sound designer, film | Gratis / $11/mese |

| AIVA | Partitura MIDI modificabile | Focalizzato su stile classico | Compositori, film scorer | Gratis / $15/mese |

| Adobe Music GenAI | Integrazione con Premiere Pro | Solo in ecosistema Adobe | Video editor Adobe | Incluso in Creative Cloud |

| LANDR | Mastering automatico | Solo mastering, non genera musica | Producer indie, home studio | $7/mese |

| Mubert | Streaming generativo in tempo reale | Scarso controllo sullo stile | App, giochi, playlist | Gratis / $14/mese |

| Soundraw | Royalty-free per sync licensing | Qualità media | Agenzie, YouTuber | $19/mese |

FAQ — Domande frequenti

La musica con AI è la creazione, generazione o produzione di musica attraverso sistemi di intelligenza artificiale. Include la generazione text-to-music (creare un brano da una descrizione testuale), l’assistenza nella produzione (suggerimenti di arrangiamento, mastering automatico) e la trasformazione di audio esistente. I principali strumenti nel 2026 sono Suno AI, Udio, Stable Audio e AIVA.

In linea generale no, almeno negli USA. Il Copyright Office americano ha stabilito che i contenuti generati interamente da AI non sono proteggibili in assenza di apporto creativo umano significativo. In Europa la situazione è in evoluzione con l’AI Act. La titolarità specifica dipende però anche dalle condizioni d’uso del singolo strumento: alcuni piani commerciali cedono all’utente i diritti sull’output generato.

Sì, ma con alcune condizioni. Spotify richiede la dichiarazione del contenuto AI al momento del caricamento e non permette di avanzare claim di copyright sull’output AI. I brani vanno etichettati come contenuto AI-generated. I piani gratuiti dei principali strumenti di solito permettono solo uso personale, quindi è necessario un piano commerciale per la distribuzione su piattaforme di streaming.

Suno AI è il punto di partenza ideale per chi inizia senza esperienza musicale: interfaccia semplice, accessibile da browser, piano gratuito generoso. Basta descrivere in italiano o inglese la musica che si vuole e il sistema genera un brano completo in pochi secondi. Per chi ha già esperienza di produzione musicale, Udio offre output di qualità superiore con maggiore controllo sullo stile.

Non completamente, e sicuramente non nel breve termine. L’AI sta comprimendo i compensi e riducendo la domanda in segmenti specifici come la library music generica e il sound design standard. Ma la performance dal vivo, la narrativa personale autentica e la connessione emotiva diretta tra artista e pubblico rimangono fuori dalla portata dell’AI. I musicisti che integrano l’AI nel loro workflow come strumento — piuttosto che combatterla — sono meglio posizionati per il futuro.

Dipende dalla qualità del brano e dall’orecchio dell’ascoltatore. Ricerche condotte nel 2025 mostrano che ascoltatori non esperti non distinguono musica AI da musica umana nel 68% dei casi per il pop. Tra musicisti professionisti la percentuale di riconoscimento corretto è più alta, soprattutto per generi come il jazz dove le micro-espressioni degli strumentisti sono difficili da simulare. In generale, la musica AI di alta qualità è sempre più difficile da distinguere.

Sì, a condizione di usare uno strumento con licenza commerciale che conceda diritti sull’output (come i piani Pro di Suno o Udio) e di non avanzare claim di copyright sul brano. Bisogna verificare le specifiche condizioni d’uso del servizio usato, poiché le licenze variano. Evita tassativamente i brani AI che potrebbero richiamare composizioni protette da copyright: YouTube Content ID è in grado di rilevare le somiglianze.

La maggior parte degli strumenti principali offre un piano gratuito con generazioni limitate e un piano Pro a pagamento tra 7 e 20 euro/dollari al mese. Suno AI Pro costa circa 10$/mese per 2.500 canzoni mensili. Udio costa circa 12$/mese per il piano standard. LANDR (per mastering automatico) parte da 7$/mese. Il costo è quindi molto accessibile rispetto alla produzione musicale tradizionale.

Un buon prompt musicale deve specificare: genere e stile (es. “indie folk malinconico”), strumentazione (es. “chitarra acustica, violoncello, batteria discreta”), mood emotivo (es. “nostalgico, intimo, riflessivo”), contesto d’uso (es. “per accompagnare un video di viaggio”), e se pertinente BPM o tonalità. Più il prompt è specifico e visivo-emotivo, migliore sarà il risultato. Evita prompt generici come “bella musica”: l’AI ha bisogno di dettagli per esprimere il suo potenziale.

Sì, anche se non sempre dichiaratamente. Diversi artisti pop e producer di livello internazionale hanno confermato l’uso di strumenti AI per la generazione di idee, backing track o elementi sonori specifici. Grimes ha esplicitamente incoraggiato l’uso della sua voce per la creazione di musica AI. Paul McCartney ha usato l’AI nel 2023 per isolare la voce di John Lennon in un vecchio nastro per la canzone “Now and Then”. L’integrazione è sempre più diffusa, anche se il dibattito sulla disclosure rimane aperto.

Conclusione

La musica con AI non è una moda passeggera — è una trasformazione strutturale dell’industria musicale paragonabile all’introduzione della registrazione audio, dell’elettrificazione degli strumenti o dello streaming digitale. Nel 2026, la capacità di creare musica di qualità accettabile è accessibile a chiunque sappia descrivere ciò che vuole sentire. Questa democratizzazione ha un costo — comprime i mercati tradizionali, erode i compensi in alcuni segmenti, complica il quadro dei diritti — ma apre anche possibilità creative e commerciali del tutto nuove.

Per chi vuole usarla in modo intelligente, la chiave è capire cosa l’AI fa bene (volume, variazione, accessibilità, atmosfere) e cosa resta esclusivamente umano (autenticità emotiva, performance dal vivo, narrativa personale). I musicisti che usano l’AI come un nuovo strumento nel loro arsenale creativo — non come un sostituto della creatività, ma come un amplificatore di essa — sono già un passo avanti rispetto a chi la ignora e due passi avanti rispetto a chi ne ha paura.

La musica con AI non è la fine della musica umana — è l’inizio di una conversazione nuova tra l’espressione umana e la macchina. Come ogni strumento nella storia, non conta chi lo usa: conta cosa ha da dire. — Il nuovo paradigma della creatività musicale nel 2026

Il prossimo passo è tuo: scegli uno strumento, scrivi il tuo primo prompt, ascolta cosa emerge. La barriera tra l’idea e il suono non è mai stata così sottile.

-

Casi Studio & Strategie2 mesi ago

Casi Studio & Strategie2 mesi agoAffiliate Marketing 2026: Perché l’AI cambierà tutto

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCreare video con intelligenza artificiale gratis

-

Casi Studio & Strategie6 giorni ago

Casi Studio & Strategie6 giorni agoRicerca Generativa: Come l’AI Sta Rivoluzionando Google e Cosa Cambia per il Tuo Sito nel 2026

-

Casi Studio & Strategie4 giorni ago

Casi Studio & Strategie4 giorni agoIA per Creare Immagini

-

Casi Studio & Strategie1 settimana ago

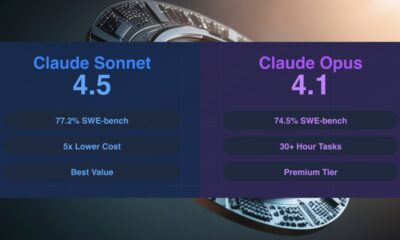

Casi Studio & Strategie1 settimana agoClaude Sonnet vs opus

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCome l’intelligenza artificiale sta influenzando gli attacchi informatici

-

Casi Studio & Strategie1 settimana ago

Casi Studio & Strategie1 settimana agoCome attivare intelligenza artificiale su iphone

-

Software & Tool AI6 giorni ago

Software & Tool AI6 giorni agoSEO AI Free Tools: I Migliori Strumenti Gratuiti per Ottimizzare il Tuo Sito con l’Intelligenza Artificiale nel 2026